Kumi der kleine Sorgenfresser

Unser erstes Projekt

PROJEKTE

Sascha Lenze

1/31/20262 min lesen

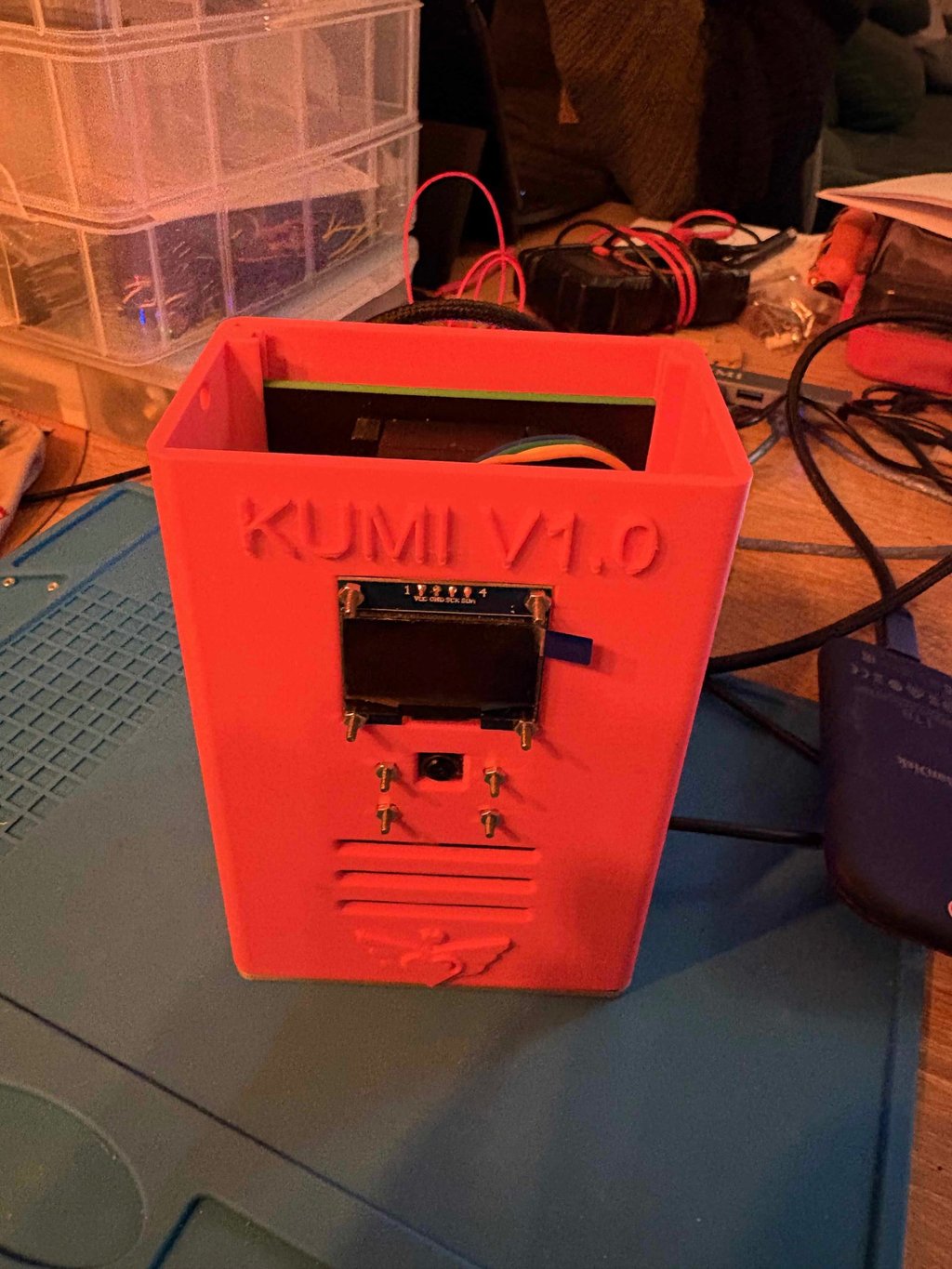

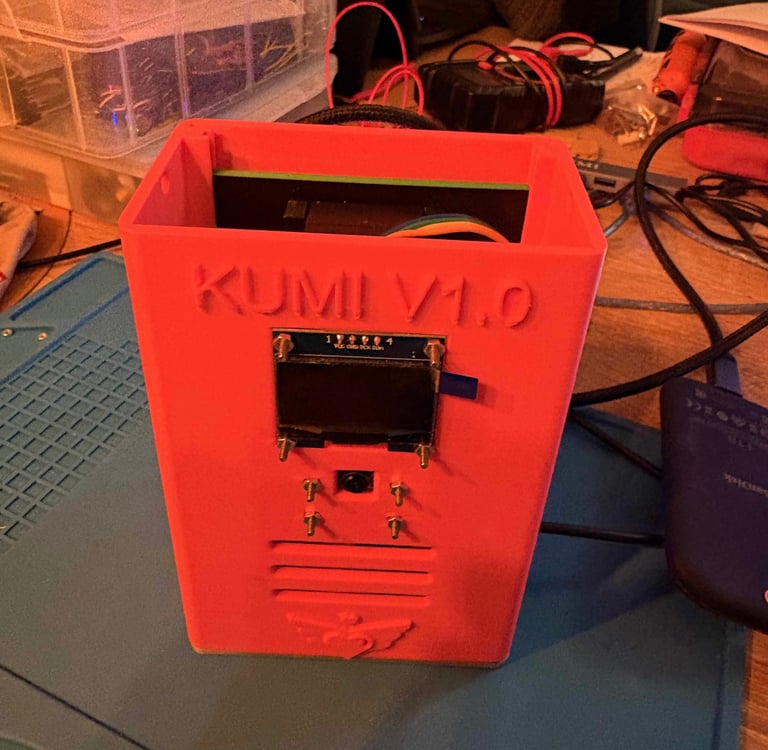

KUMI V1.0 - Der Sorgenfresser-Roboter

Was ist KUMI?

KUMI ist ein therapeutischer "Sorgenfresser"-Roboter für Kinder zwischen 6-12 Jahren. Das Projekt entsteht im Rahmen des Wildwuchskollektivs in Straelen als Inklusionsprojekt. Kinder lernen in Workshops die Grundlagen der Robotik und bauen ihren eigenen KI-Begleiter, den sie mit nach Hause nehmen können.

Das Besondere: KUMI läuft komplett lokal - keine Cloud, keine Datensammlung, 100% DSGVO-konform für den Einsatz in Schulen (OGS).

HARDWARE-KOMPONENTEN

Gehirn & Verarbeitung:

• Raspberry Pi 4 (4GB) - Hauptrechner für KI und Steuerung (~45€)

• MicroSD-Karte 32GB - Betriebssystem und Daten (~8€)

Audio (Hören & Sprechen):

• ReSpeaker 2-Mic HAT - Mikrofon-Array für Spracherkennung (~15€)

• Mini-Lautsprecher (2x) - Für die Sprachausgabe (~5€)

Sehen:

• Pi Camera 2 (IMX219) - Gesichtserkennung & Präsenz (~25€)

Display (Emotionen):

• OLED Display SH1106 (1.3") - Zeigt Augen/Emotionen, 128x64 Pixel (~8€)

Bewegung (geplant):

• Servo-Motoren (4x) - Für Arme und Kopfbewegung (~15€)

• Servo-Controller - PWM-Steuerung (~5€)

Stromversorgung:

• 10.000mAh Powerbank - Im "Rucksack" integriert, mehrere Stunden Laufzeit (~15€)

• USB-C Kabel (~3€)

Gehäuse:

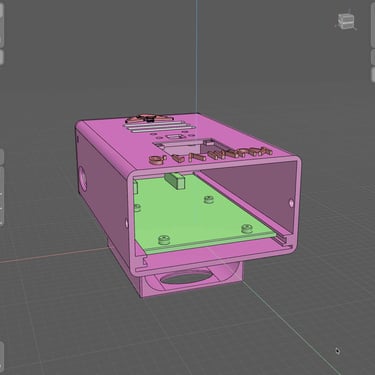

• 3D-gedrucktes Gehäuse - Pink/Rot/Silber, Bambu Lab P1S (~10€ Filament)

• Magnete (6mm) - Für Deckel-Verschluss (~3€)

Gesamtkosten pro KUMI: ca. 150-160€

SOFTWARE-STACK

Spracherkennung:

Faster-Whisper (CTranslate2) für lokale Speech-to-Text. Modell: tiny.en mit INT8-Quantisierung - etwa 4x schneller als das Original.

KI / Sprachmodell:

Ollama mit Llama 3.2 (3B) läuft komplett lokal auf dem Pi 4. Optimiert mit 1024 Token Context und 4 Threads.

Sprachausgabe:

Piper TTS für natürliche Stimme (en_US-amy-medium) mit espeak als Fallback.

Gesichtserkennung:

OpenCV mit Haar Cascade und picamera2. Histogram-basierte Erkennung ohne dlib.

Display:

luma.oled für OLED-Ansteuerung mit 12 verschiedenen Emotionen und Status-Text.

WAS KUMI KANN

Bereits implementiert:

Sprachinteraktion

• Hört zu wenn Button gedrückt wird (bewusste Aktivierung!)

• Versteht gesprochene Sprache

• Antwortet mit natürlicher Stimme

• 3-Stufen-Antwortsystem: Schnell → Persönlich → KI

Emotionen & Display

• 12 verschiedene Augen-Ausdrücke (glücklich, traurig, neugierig, nachdenklich...)

• Animiertes Blinzeln im Idle-Modus

• "Push button to talk" Anzeige

• Animierte "Thinking..." Punkte während die KI denkt

Persönlichkeit & Gedächtnis

• Lernt den Namen des Kindes

• Merkt sich Alter und Hobbies

• Speichert persönliche Fakten aus Gesprächen

• Erkennt über 50 Themen (Schule, Familie, Freunde, Ängste...)

• Passt Antworten an bekannte Informationen an

Sicherheit & Privatsphäre

• Owner-System: Nur das registrierte Kind kann mit KUMI sprechen

• Gesichtserkennung zur Identifikation

• Geheimer Reset-Code: "Rainbow Unicorn" 🌈🦄

• Alle Daten lokal, keine Cloud

In Entwicklung:

• Servo-Bewegungen für Arme

• Deutsche Sprachunterstützung

• Mehr Persönlichkeits-Anpassung

DAS GEHÄUSE

Das KUMI-Gehäuse wurde auf einem Bambu Lab P1S 3D-Drucker erstellt:

• Form: Aufrechtes Rechteck mit "Gorilla-Armen" (länger als der Körper)

• Farben: Pink, Rot, Silber

• Integrierte Aussparungen für Display, Kamera, Lautsprecher

• "Rucksack" auf der Rückseite für die Powerbank

• Magnetischer Deckel-Verschluss

• Flügelherz-Logo

WORKSHOP-KONZEPT

8 Sessions für Kinder (6-12 Jahre):

1. Was ist ein Roboter? - Einführung

2. Elektronik-Basics - LEDs, Kabel, Strom

3. Der Raspberry Pi - Das Gehirn

4. Sensoren - Hören und Sehen

5. Programmieren - Erste Schritte

6. KI verstehen - Wie lernt ein Roboter?

7. Zusammenbau - Alles wird eins

8. Mein KUMI - Personalisierung & Mitnahme

Kein fester Zeitrahmen - Kinder arbeiten in ihrem eigenen Tempo.

MITMACHEN?

Das Projekt ist Teil des Wildwuchskollektivs Straelen - ein Inklusionskollektiv, das kostenlose Workshops für Kinder anbietet.

Das Projekt ist Open Source und wird nach Fertigstellung veröffentlicht.

Stand: Januar 2026